NEVAKI: Neuro-symbolische Validierungsarchitektur für vertrauenswürdige KI-Systeme

Künstliche Intelligenz, insbesondere große Sprachmodelle, wird zunehmend in sensiblen Bereichen eingesetzt, etwa im Gesundheitswesen, in der öffentlichen Verwaltung, im Finanzsektor oder im Rechtswesen. Gleichzeitig zeigt sich, dass diese Systeme ihre Ergebnisse nicht nach festen Regeln erzeugen, sondern auf Wahrscheinlichkeitsmodellen beruhen. Dadurch können Antworten unterschiedlich ausfallen, in Nuancen variieren oder nicht ohne Weiteres exakt reproduziert werden. Gerade in regulierten Umgebungen sind jedoch Nachvollziehbarkeit, Regelkonformität und Verlässlichkeit unverzichtbar.

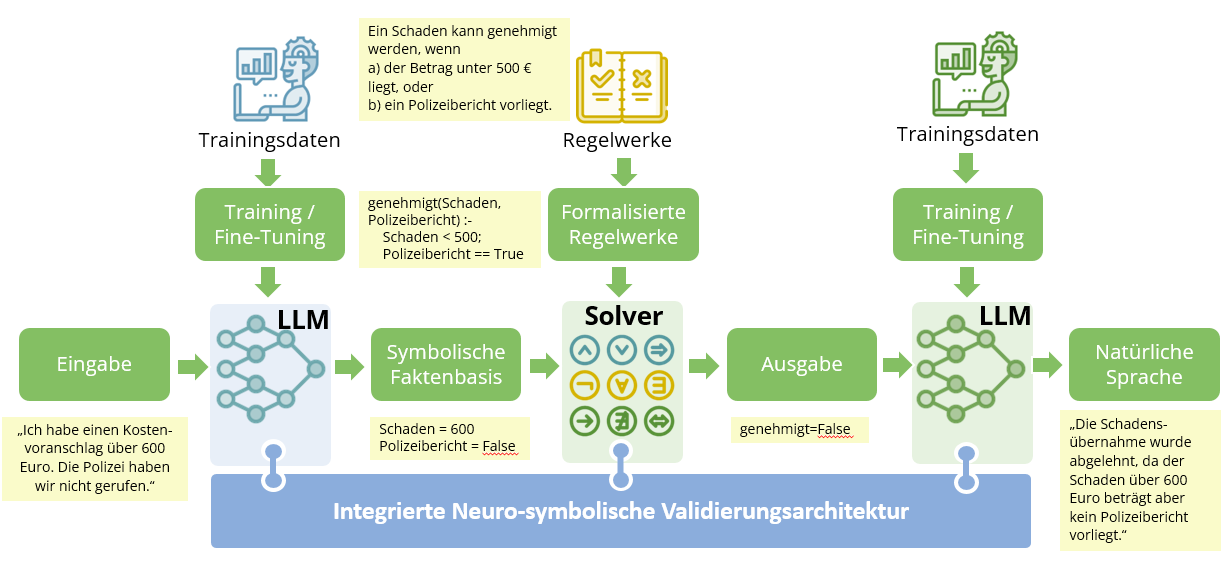

Hier setzt das Forschungsprojekt NEVAKI an. Ziel ist die Entwicklung einer neuartigen Validierungsarchitektur, die flexible, kontextbezogene Sprachverarbeitung durch KI-Modelle mit deterministische Prüfmechanismen, wie sie aus der Logik und der regelbasierten Wissensverarbeitung bekannt sind, kombiniert. Natürliche Sprache, etwa juristische Texte, medizinische Befunde oder Compliance-Richtlinien, wird zunächst durch KI analysiert und in strukturierte Wissenselemente überführt. Diese werden anschließend gegen formalisierte Regeln geprüft. Das Ergebnis ist eine reproduzierbare Bewertung, die zudem verständlich begründet werden kann.

NEVAKI ist ein SAB-InnoTeam-Projekt, das gemeinsam mit der Nibiru Systems GmbH durchgeführt wird. Damit verbindet das Vorhaben wissenschaftliche Forschung mit praxisnaher Entwicklung für vertrauenswürdige KI-Systeme.

Ziele des Projekts

NEVAKI verfolgt mehrere miteinander verknüpfte Ziele:

- Entwicklung einer Architektur zur systematischen Validierung KI-generierter Inhalte

- Überführung natürlichsprachlicher Anforderungen in formal prüfbare Regeln

- Reduktion von Unsicherheiten und Fehlinterpretationen durch klare Prüfmechanismen

- Bereitstellung verständlicher und nachvollziehbarer Begründungen für Prüfergebnisse

Am Ende des Projekts soll ein funktionsfähiger Demonstrator im Labormaßstab vorliegen, der die Machbarkeit dieses Ansatzes zeigt.

Abbildung: Integrierte neuro-symbolische Validierungsarchitektur. Ein LLM überführt einen natürlichsprachlichen Eingang in strukturierte Fakten, die durch einen regelbasierten Solver geprüft werden. Das Ergebnis wird anschließend verständlich in natürlicher Sprache ausgegeben.

Anwendungsbereiche

Die Validierungsarchitektur wird exemplarisch in besonders anspruchsvollen Textdomänen erprobt. Dazu gehören unter anderem:

- juristische Schriftsätze

- Patentschriften

- Compliance-Dokumente

- medizinische Beschreibungen

Diese Bereiche zeichnen sich durch komplexe, oft mehrdeutige Sprache und hohe regulatorische Anforderungen aus. Gerade hier ist eine zuverlässige und nachvollziehbare Prüfung entscheidend.

Projektlaufzeit: 01.05.2026 bis 30.09.2028

Projektpartner: Nibiru Systems GmbH

Förderkennzeichen: 100795569